「AI ゴミ報告」殺到で HackerOne が新規受付停止 — バグバウンティの信頼コスト急騰が示す LLM 時代の信号雑音崩壊

HackerOne が AI 生成の低品質脆弱性報告殺到で新規受付を一時停止。Google も OSS バウンティで「AI 自動生成報告は対象外」に転換。LLM がノイズを量産し、人間がシグナルを選別するコストだけが残る構造を読む。

AI で量産された低品質な脆弱性報告(「AI スロップ」)の急増を受け、セキュリティプラットフォーム HackerOne が 3 月末に新規受付を一時停止した。Google も OSS 脆弱性報告プログラムを更新し「AI 自動生成報告は対象外」に方針転換。LLM がノイズを生み、人間がシグナルとノイズを分離するコストだけが残るという「信号雑音崩壊」の典型例として、コミュニティ運営型セキュリティの再設計が急務になっている。

要点

- HackerOne が AI 生成「ゴミ報告」殺到で新規受付を 3 月 28 日に一時停止

- セキュリティ企業 Minimus によれば 5 種類のカテゴリーで報告数が 50% 以上減少

- LLM 出力品質 の問題:LLM は「もっともらしいが再現不可能な」脆弱性記述を大量生成

- Google は「AI 自動生成報告は対象外 / 再現可能性と実質的影響の証明を義務化」に転換

- 投稿コスト低下 → トリアージコスト急騰という AI の悪用 の典型パターン

なぜ重要か

バグバウンティは「正当な発見者が報酬を得る」インセンティブ設計で動く仕組みだ。AI で脆弱性発見コストを下げる方向は本来歓迎すべきだが、「検証コストを発見者が負わない」モデルが破綻の本質にある。重大な本物の脆弱性が「ゴミ報告」の海に埋もれ、対応が遅延するリスクは AI 安全性 の観点から深刻だ。ソフトウェアサプライチェーンセキュリティ の文脈では、OSS プロジェクトの脆弱性発見が遅れれば、そのライブラリを使うすべてのソフトウェアのリスクが上がる。

続きは note で

問題の構造・Google の解決策の評価・Anthropic の Claude Security ベータとの対比・JPCERT/IPA への示唆は note の有料記事で。

無料部分: 導入と問題提起 / 有料部分: 構造分析と対策提言

参考

関連記事

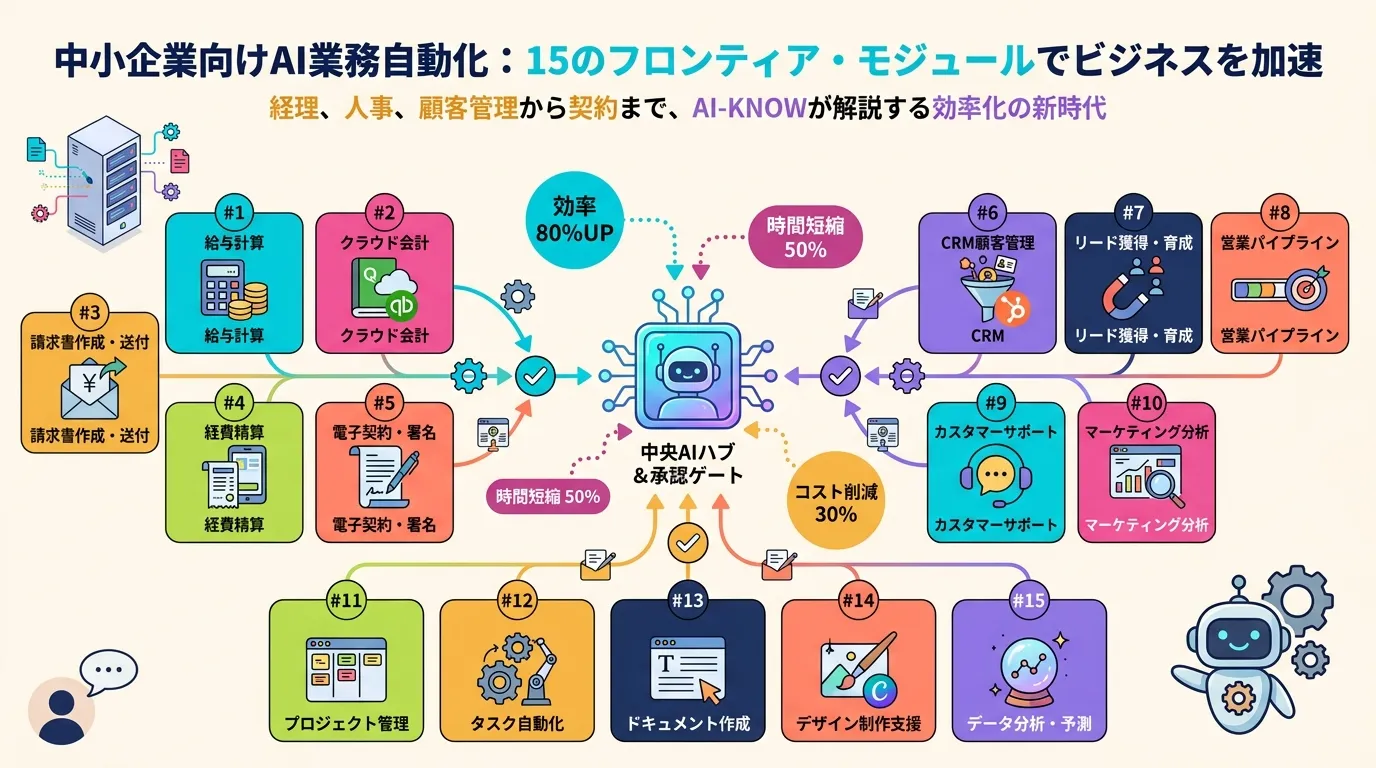

Anthropic、中小企業向け「Claude for Small Business」公開 — 15 ワークフローで SMB の AI 格差を解消へ

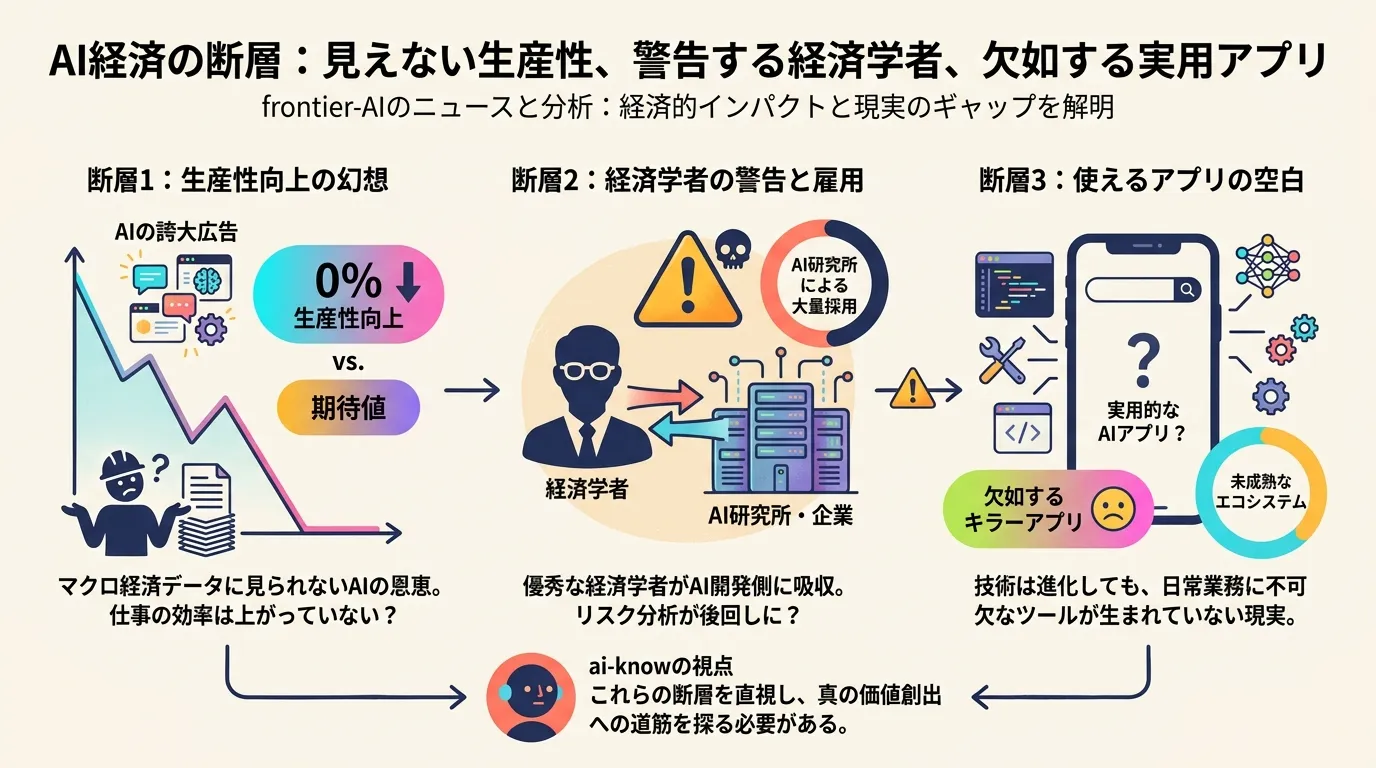

「エージェント過信・経済学者採用ブーム・使えるアプリ不在」— Acemoglu が示す 2026 年 AI 経済の 3 断層線

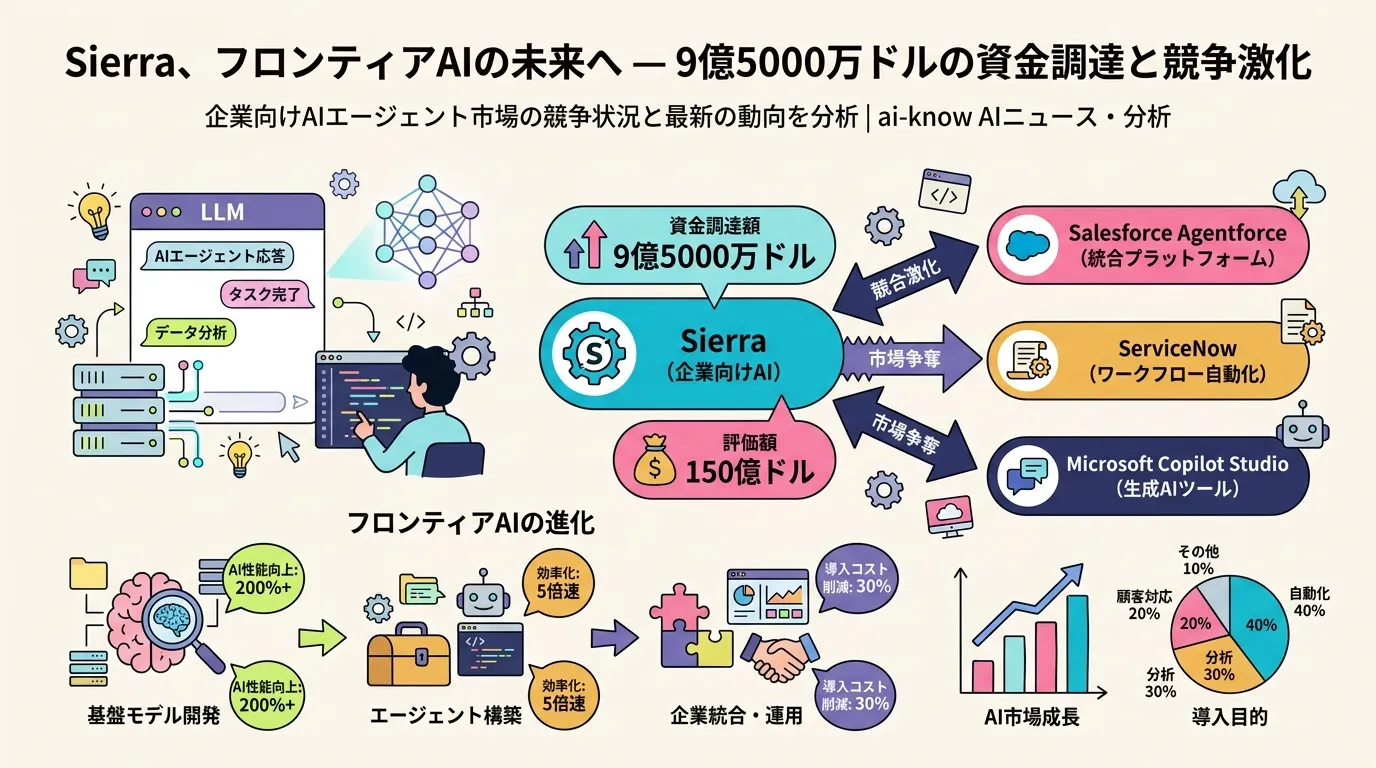

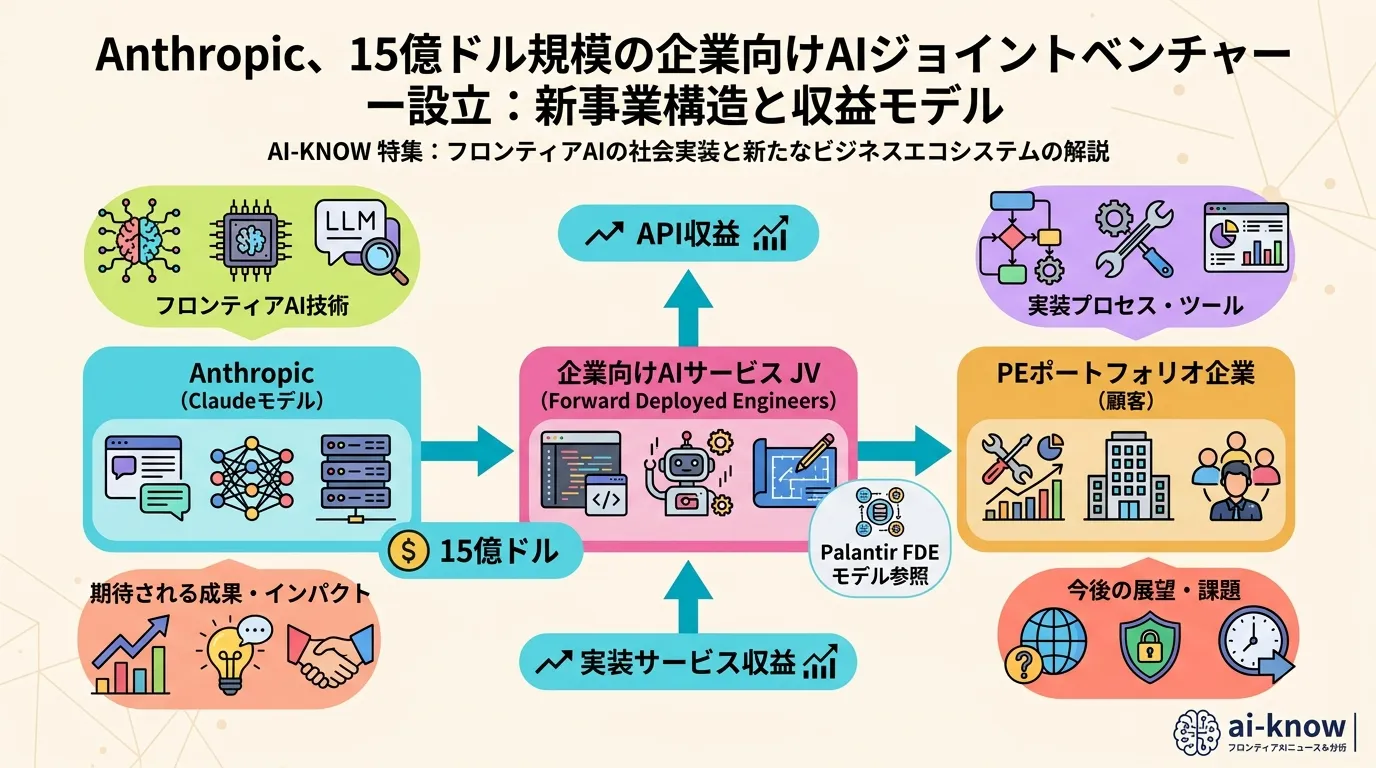

Anthropic・Blackstone・Goldman Sachs が15億ドルの企業AI実装 JV を設立 — フロンティアラボが「実装主権」市場に参戦

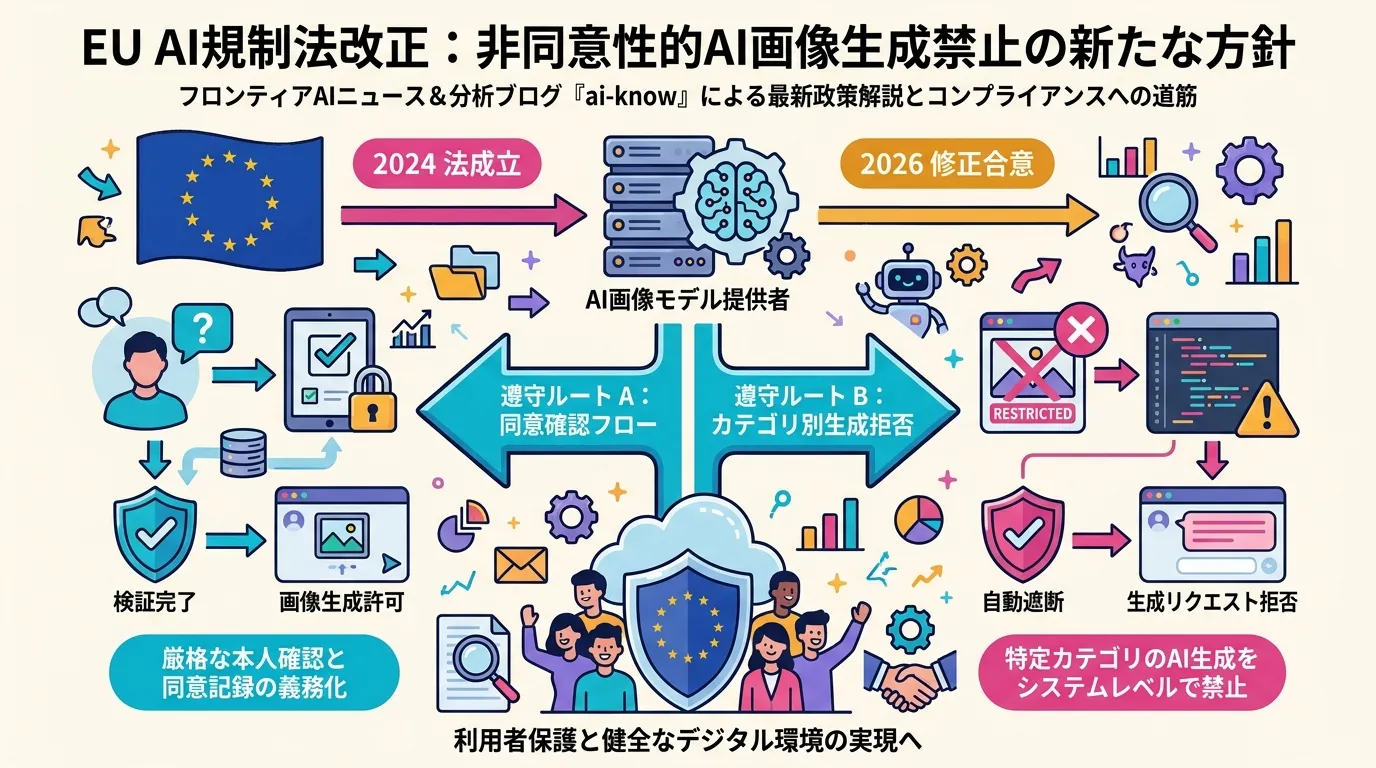

EU AI法改正、無許可AI生成性的画像を法的に禁止 — 画像生成モデル提供企業が迫られる同意確認義務

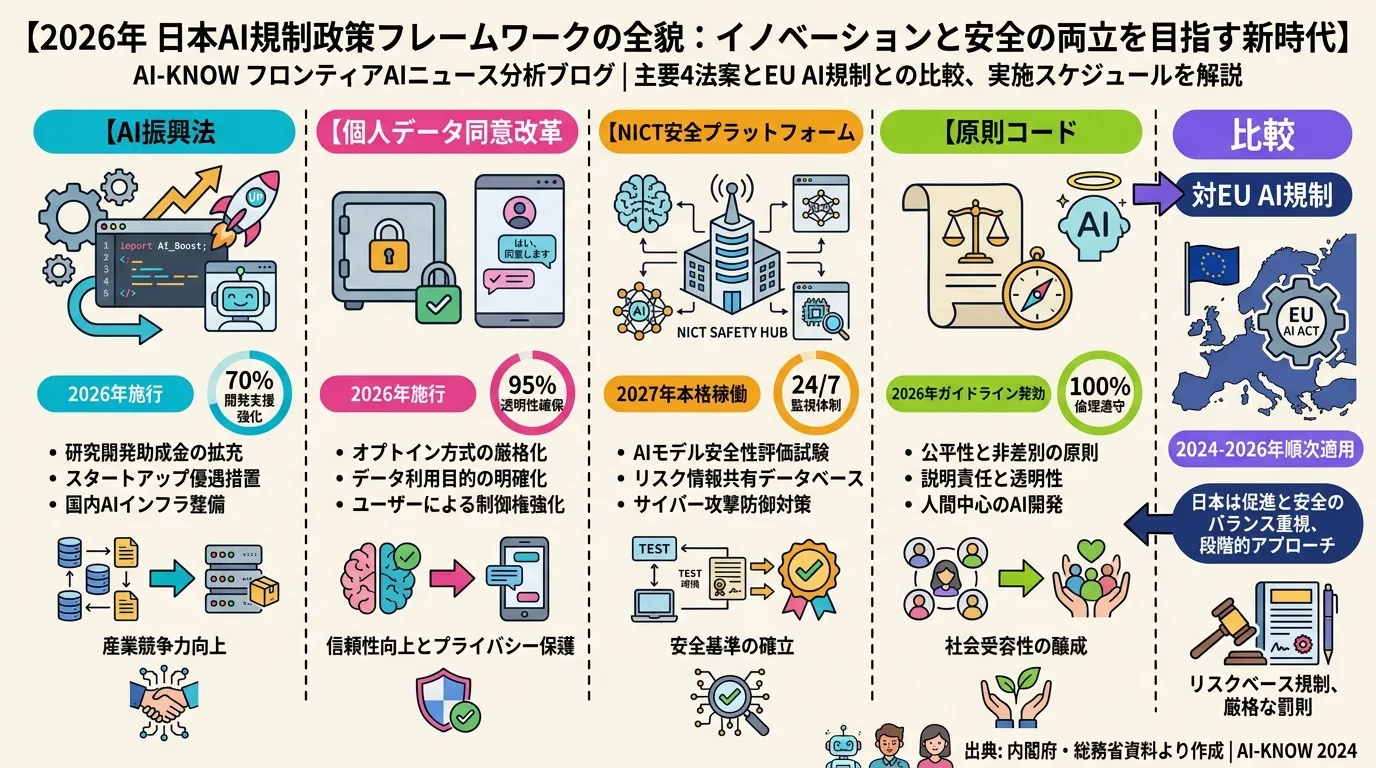

日本 AI 規制2026最新動向 — 推進法・データ同意免除・NICT 評価基盤が三つ巴で動く