日本 AI 規制2026最新動向 — 推進法・データ同意免除・NICT 評価基盤が三つ巴で動く

EU と正反対の促進優先路線、企業が今すぐ把握すべき四つの変化

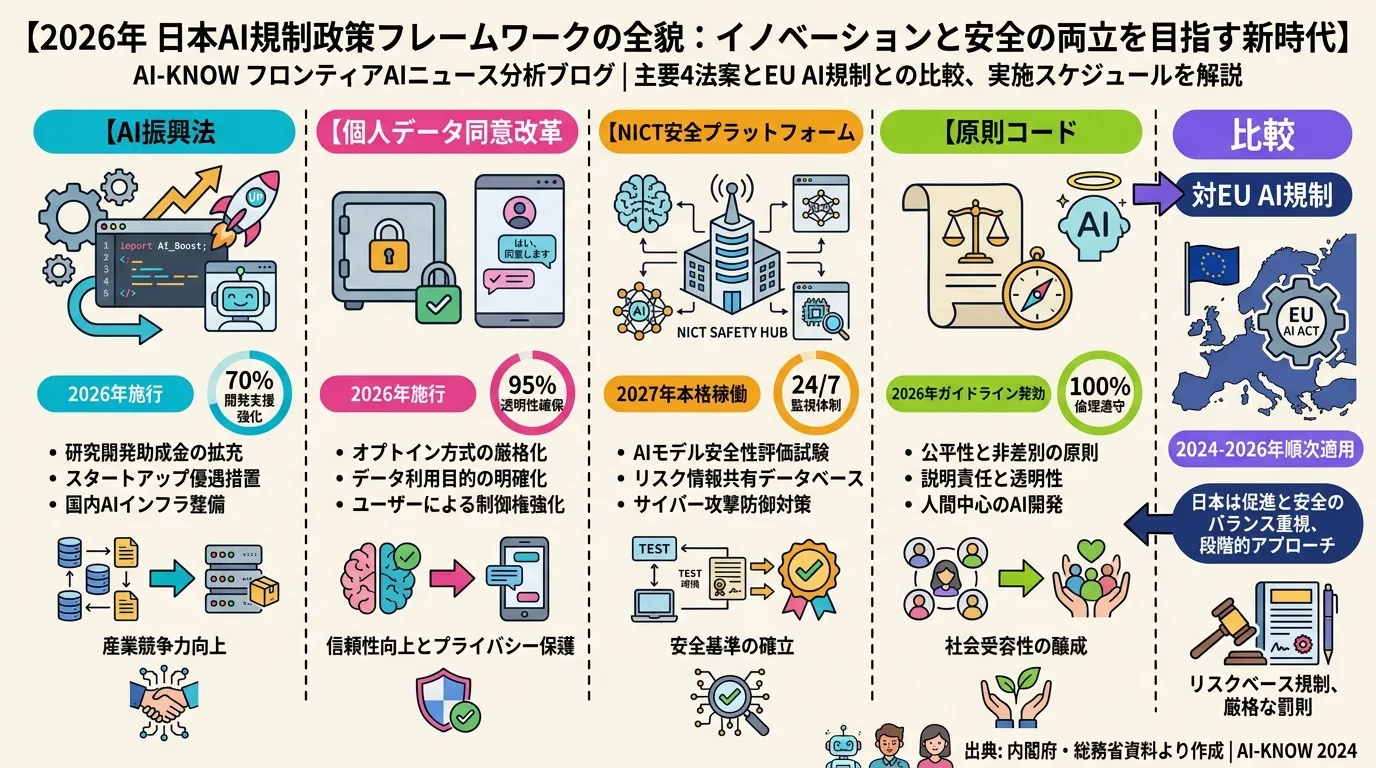

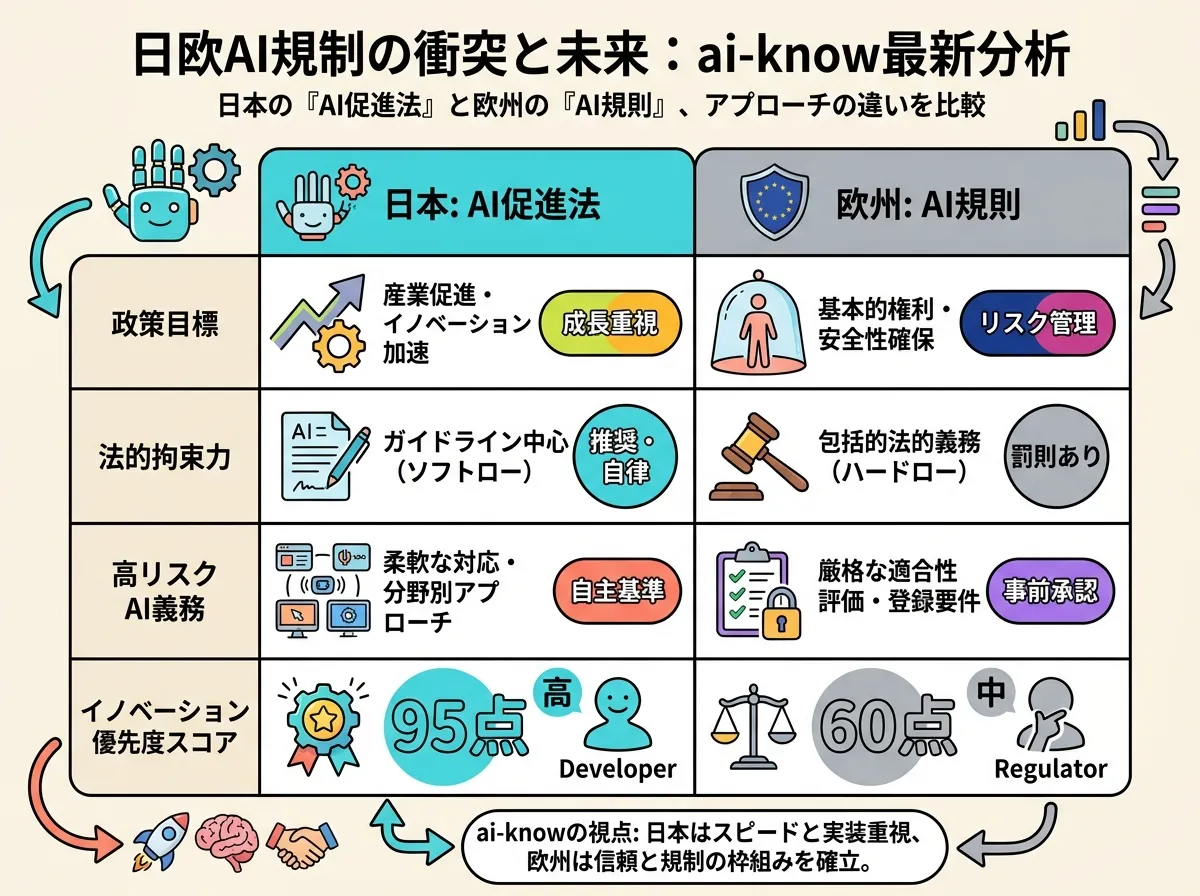

2026年5月時点、日本の AI 規制は「促進優先・軽規制」路線を維持しつつも、個人データ・著作権保護・安全性評価の三軸で具体的施策が同時進行している。EU AI Act が拘束力のある義務規制として運用される一方、日本は「AI ガバナンス の実現手段としてのソフトロー」という独自路線を選んだ。

この選択は ソブリン AI 戦略の一環でもある。国内 AI 産業の育成を優先しながら、G7 広島 AI プロセスを通じた国際調和も図るという二正面作戦が、2026年の日本 AI 政策の核心だ。

AI 推進法の骨格 — 「ソフトロー」設計の意味

AI 推進法(人工知能関連技術の研究開発及び活用の推進に関する法律)は2025年9月に全面施行された。EU AI Act と根本的に異なるのは目的設定だ。EU は「リスク管理」を主目的に義務を課す規制アプローチをとる。日本の AI 推進法は 「イノベーション促進」を主目的とし、高リスク AI への義務規定は最小限に留まる設計だ。

多くの要件は努力義務または自主的なガイドラインに委ねられる。批判的な視点からは「規制の空白」と見なされることもあるが、支持者は「迅速な実験と国内 AI 産業育成を妨げない」点を評価する。

個人データ同意免除が実現するとき

2026年1月、個人情報保護委員会が AI 学習目的に限り個人データの第三者提供への本人同意を不要とする方向性を検討中と公表した。

実現すれば、国内 AI 企業の学習データ調達コストが大幅に下がる可能性がある。金融・医療・小売などのセクターでは、本人同意取得コストがデータパイプライン整備の最大のボトルネックだった。一方、プライバシー権との緊張は続いており、最終的な判断は政治的な折り合いを要する。法的不確実性が続く間は、早期の大規模対応は慎重に判断したい。

NICT 評価基盤とプリンシプル・コード

NICT(情報通信研究機構) は2026年から生成 AI の信頼性・安全性を評価する AI 基盤システムの開発を開始した。政府が「第三者評価機関」として機能することで、民間自主規制の信頼性を底上げする狙いがある。政府調達基準への要件組み込みが進めば、NICT 評価取得が事実上の参入条件になる可能性がある。

プリンシプル・コード(案) は内閣府が2025年12月に公表した行動原則集で、AI 開発者・提供者に対し透明性・著作権保護・バイアス管理に関するガイドラインを示す。法的拘束力は持たないが、取引先審査や EU パートナーとの契約交渉で実質的な参照基準になりえる。

国際比較と企業への実務インパクト

「日本のソフトロー路線は短期的には企業に自由を与えるが、国際取引先からの透明性要求に備える準備は今から必要だ」

G7 広島 AI プロセスや OECD AI 原則との整合は引き続き課題だ。EU・米国との AI 安全評価基準の相互認証が進まない場合、グローバルに事業を展開する日本企業はダブルスタンダード対応を迫られるリスクがある。

企業が今すぐ準備すべき点:

- 個人データ同意免除 → 実現すれば学習データ整備コストが下がる、ただし最終決定まで大規模対応は様子見が賢明

- NICT 評価基盤 → 政府調達・準公共案件では第三者認証が事実上の要件になる可能性あり

- プリンシプル・コード → EU 取引先・グローバルパートナーとの契約で参照される可能性があり、対応ロードマップを早期に整理すべき

関連記事

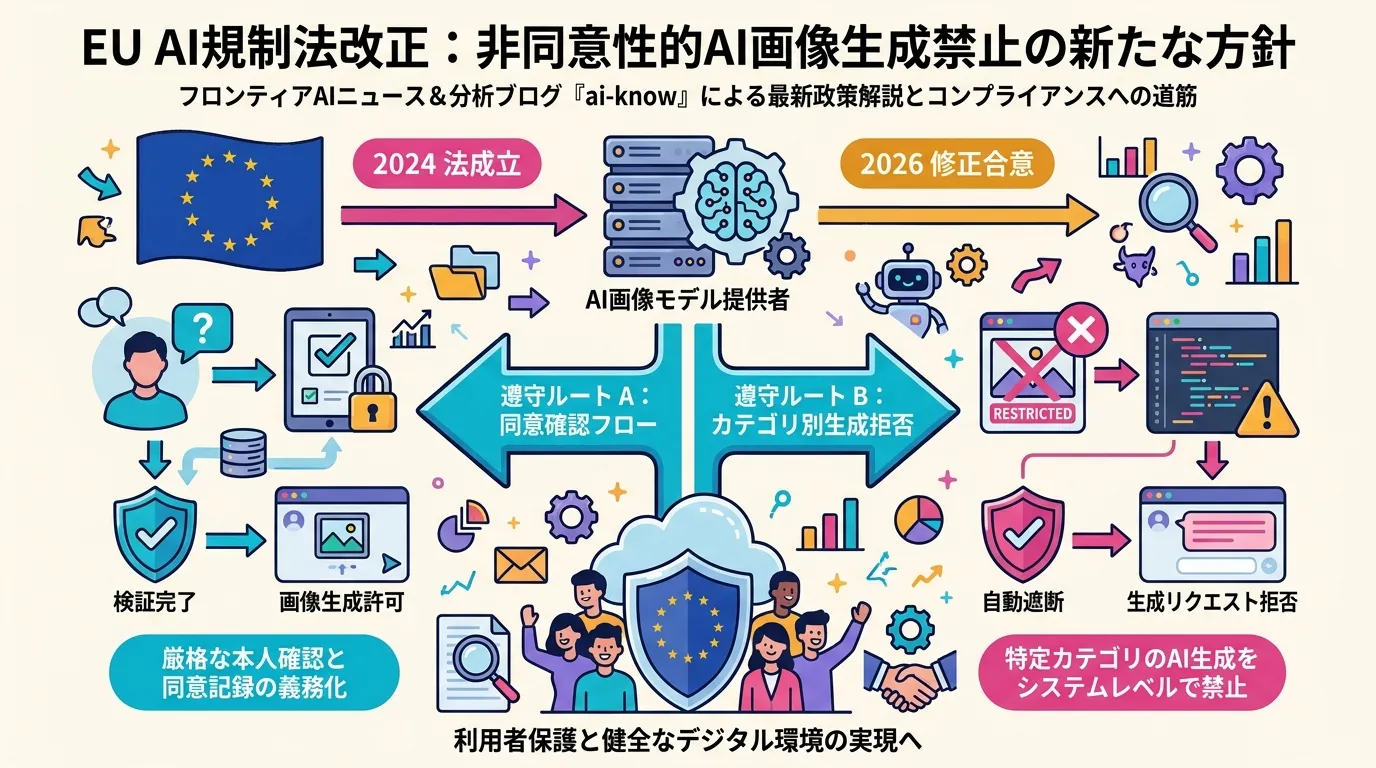

EU AI法改正、無許可AI生成性的画像を法的に禁止 — 画像生成モデル提供企業が迫られる同意確認義務

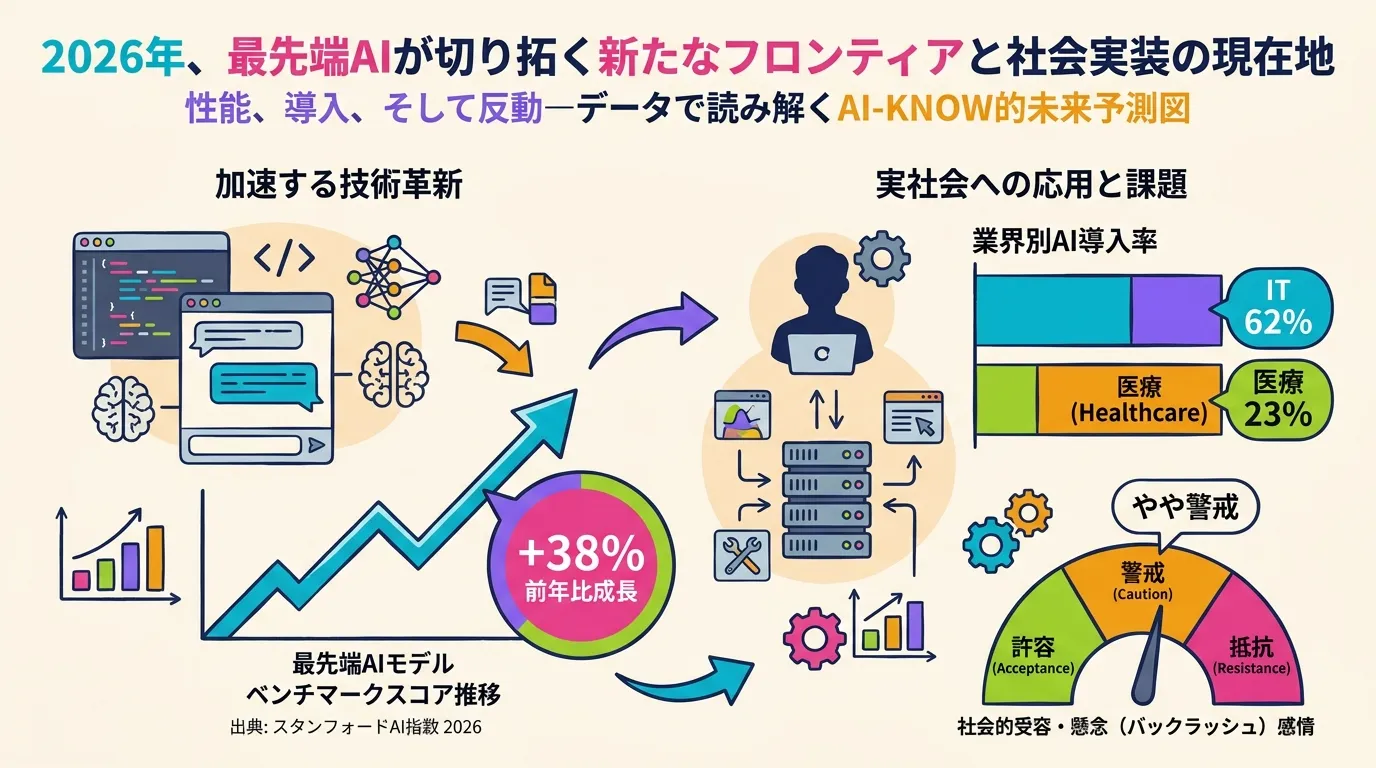

AI の現在地を読む 10 枚のグラフ — Stanford AI Index 2026 × MIT TR が照らす進化と格差

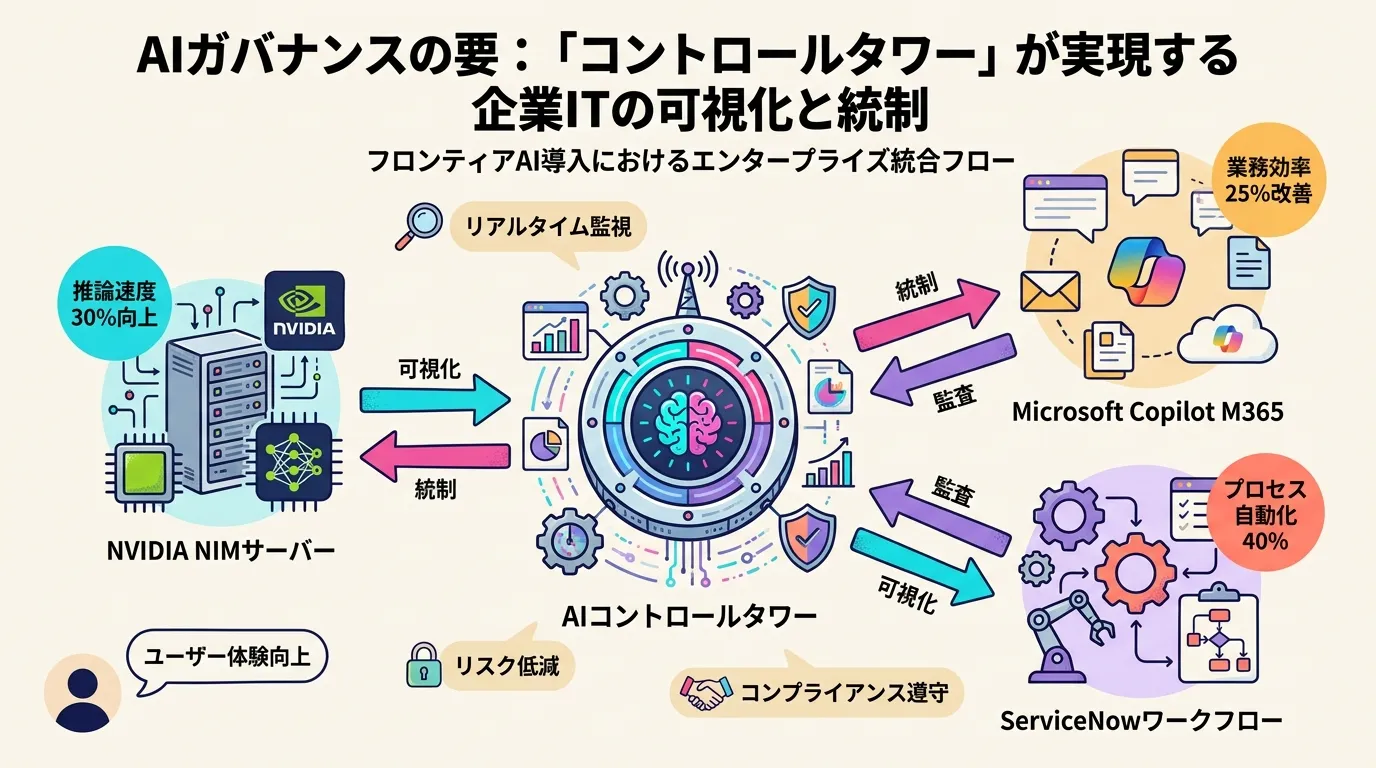

ServiceNow の「AI Control Tower」— NVIDIA・Microsoft 連携でエージェント AI ガバナンスをデータセンターへ

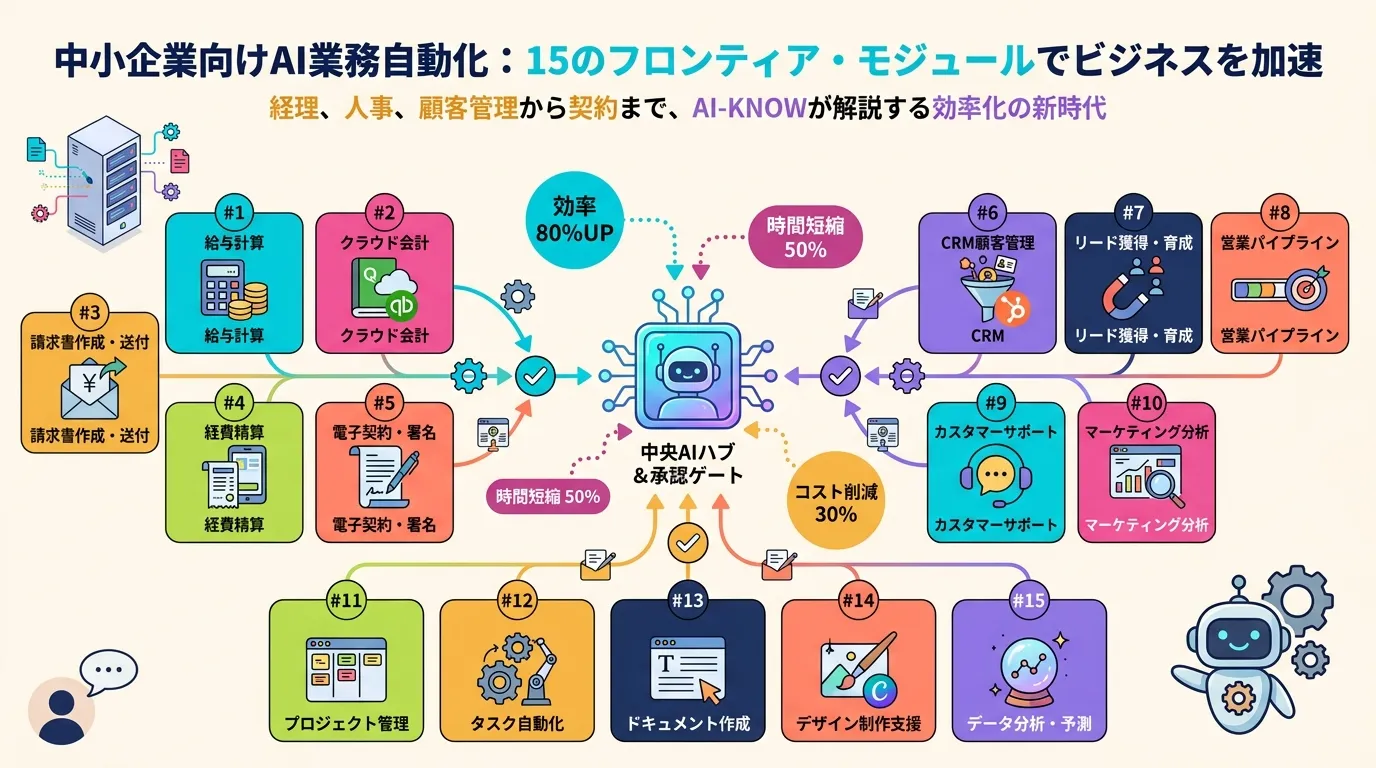

Anthropic、中小企業向け「Claude for Small Business」公開 — 15 ワークフローで SMB の AI 格差を解消へ

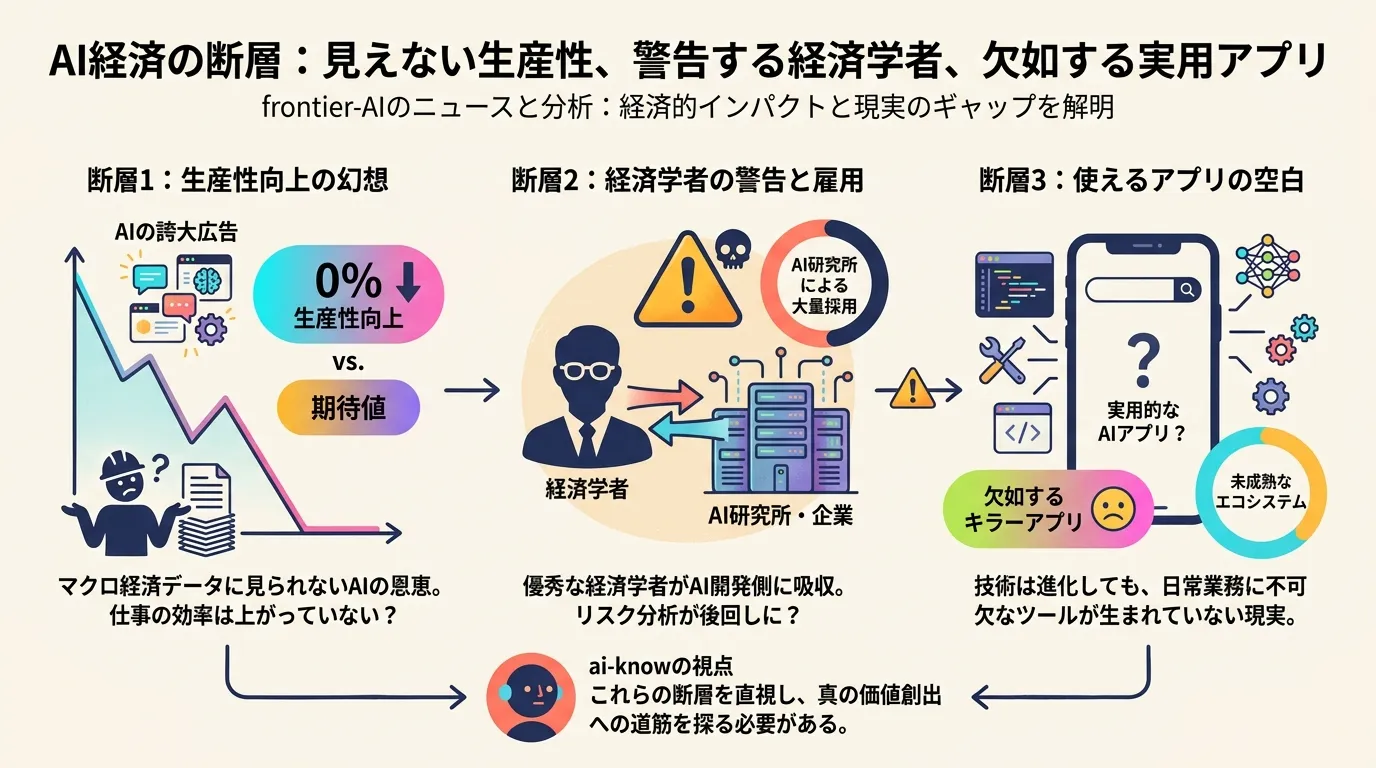

「エージェント過信・経済学者採用ブーム・使えるアプリ不在」— Acemoglu が示す 2026 年 AI 経済の 3 断層線