AI 計算インフラ投資の現在地 2026 — Anthropic 500 億ドル / xAI Colossus / Google-Broadcom を比較する

超大規模ハイパースケーラーが 69 兆円を注ぎ込む一方、電力制約が次のボトルネックに——計算インフラ戦争の全体地図を整理する

2026 年、AI 計算インフラへの投資が桁の違う次元に突入した。主要 5 社(Amazon・Microsoft・Alphabet・Meta・Oracle)の設備投資合計は 6,600 億〜6,900 億ドル(約 103 兆円)に達し、うち約 75% が AI インフラに充てられる。単年の投資額として人類史上最大規模だ。

これはもはや「クラウドの拡張」ではなく「計算の主権争い」だ。大量の NVIDIA GPU、Google TPU、カスタム ASIC、そして電力——これらを誰がどこに確保するかが、2026 年以降の AI 能力競争の帰趨を決する。本記事は主要プレイヤーの戦略を 4 つの軸で整理し、その含意を読み解く。

現状の主要プレイヤー

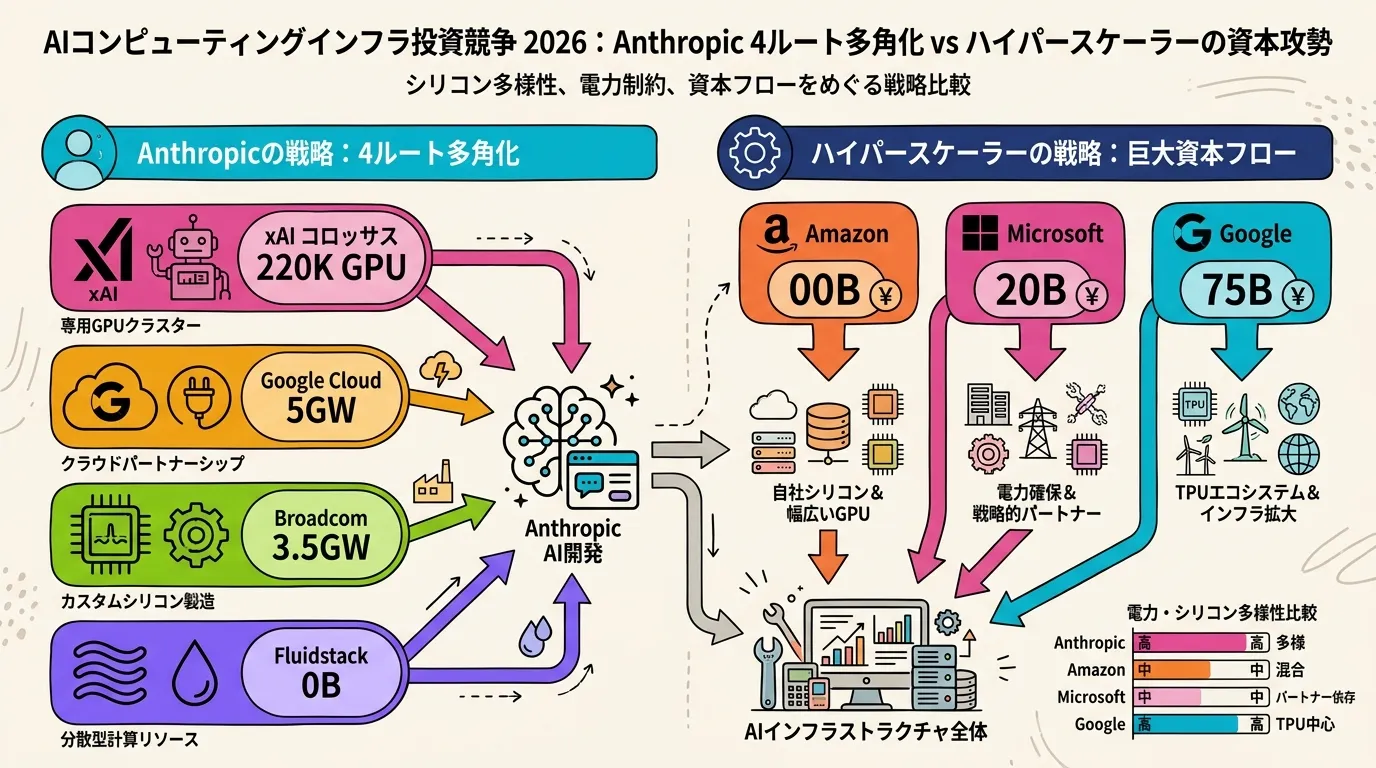

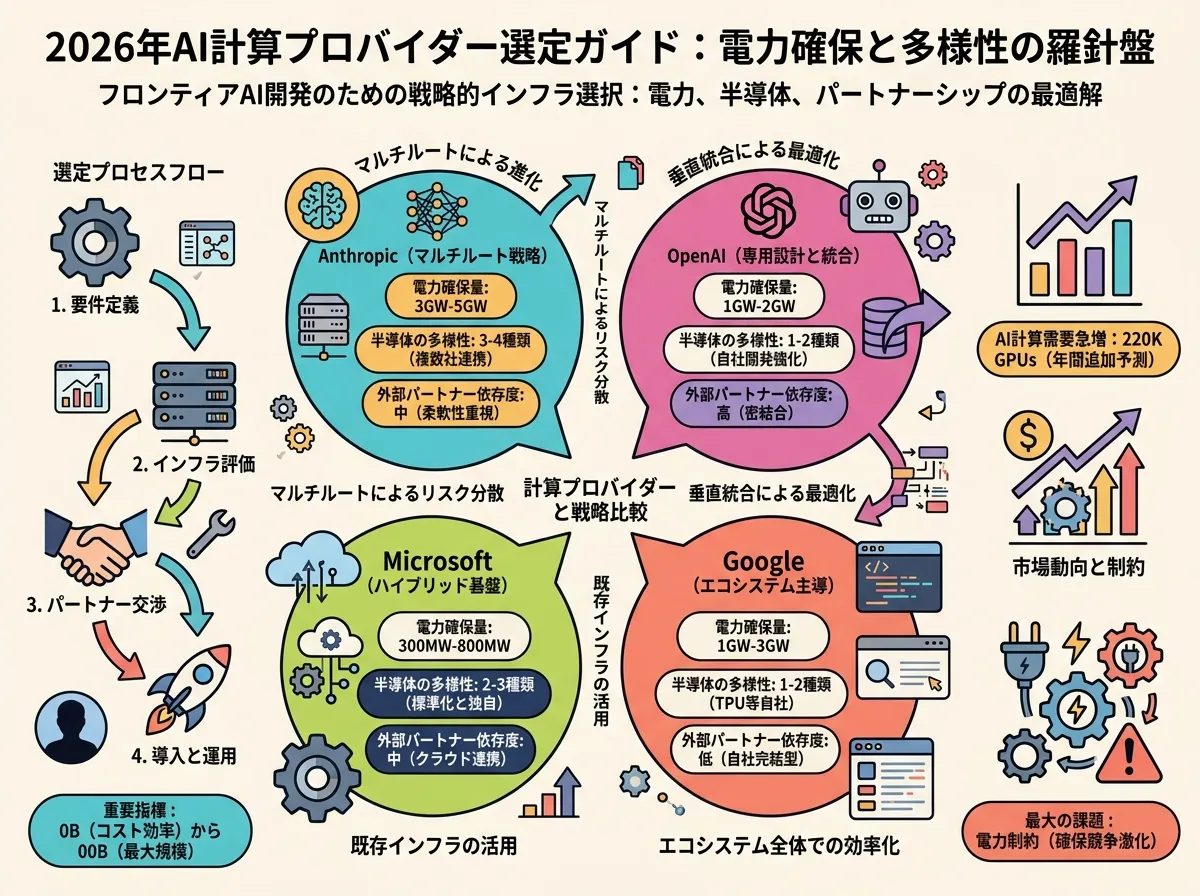

Anthropic:多ベクトル分散戦略

Anthropic は 2026 年 5 月時点で 4 つの異なる経路から計算資源を確保するという、他社に類を見ない分散アプローチを取っている。

-

xAI Colossus 1 全キャパシティ賃借(2026年5月): Elon Musk の xAI が Memphis の旧 Electrolux 工場に構築したスーパーコンピュータ「Colossus 1」の全計算容量を利用する契約を締結。220,000 台以上の NVIDIA GPU、300 メガワットの電力容量を月内に確保。なお xAI は Colossus 2(より大規模)を自社用に保持する。Musk は「誰も私の悪の検出器を反応させなかった」とコメント、商敵との異例の提携が話題を呼んだ。

-

Fluidstack と共同の米国内自社データセンター(2025年11月〜): テキサス・ニューヨークを手始めに、Fluidstack と共同で $500 億(約 7.8 兆円)を米国 AI インフラに投資する計画を発表。2026 年中に順次稼働予定。常勤 800 名・建設 2,400 名の雇用を創出し、米国 AI 主権強化を掲げる。

-

Google Cloud 5 年間 $2,000 億契約 + TPU アクセス: Google は Anthropic に $400 億(現金 + コンピュート)を出資し、同時に 5 年間 5GW の Google Cloud キャパシティを提供する大型契約を締結。Broadcom 経由のカスタム TPU チップも順次供給される。

-

Broadcom カスタムシリコン(2027〜): Anthropic 向けの専用テンソル処理ユニットを Broadcom が開発・供給。2027 年から 3.5 GW の計算資源が追加される。Broadcom は Anthropic 由来の AI 収益を 2026 年で $210 億、2027 年で $420 億と試算している。

この多ベクトル戦略の背景にあるのは、単一ベンダーへの依存リスク排除と、AWS Trainium・Google TPU・NVIDIA GPU・カスタム ASIC という 4 種類の異なるシリコンを用途別に使い分ける柔軟性だ。

OpenAI:$500 億の計算集中投資

OpenAI は 2026 年の計算コスト単年で $500 億(約 7.8 兆円)の支出を計画している。これは同社の 2026 年予想収益 $250〜300 億のほぼ 2 倍に相当し、投資先行型の構造が際立つ。Microsoft・Oracle・NVIDIA・Broadcom との長期インフラ契約で $1.4 兆超の計算資源をコミットしている。

Microsoft:$1,200 億超の設備投資

Microsoft は 2026 年通年で $1,200 億以上の設備投資を計画。しかし電力制約が深刻で、$800 億分の Azure 注文が電力供給不足で履行不能という事態が表面化している。計算需要に電力インフラが追いついていない現実を象徴する事例だ。

Google(Alphabet):$1,750 億の多極展開

Google DeepMind 親会社の Alphabet は 2026 年設備投資を $1,750 億と見込む。Google Cloud 経由で自社 TPU を Anthropic などの外部パートナーに提供しつつ、DeepMind の研究インフラも並行整備する二本柱の運用だ。

比較表:主要プレイヤーの 2026 年インフラ戦略

| 事業者 | 2026年設備投資 | 主要シリコン | 特徴的な戦略 |

|---|---|---|---|

| Amazon / AWS | $2,000 億 | NVIDIA GPU + Trainium | 最大規模、Anthropic に Trainium 提供 |

| Alphabet / Google | $1,750 億 | Google TPU + GPU | 外販(Anthropic に TPU 5GW 供給) |

| Microsoft / Azure | $1,200 億+ | NVIDIA GPU | $800 億分の電力制約バックログ |

| Meta | $1,150〜1,350 億 | NVIDIA GPU | 自社研究・Llama 系モデル訓練 |

| Oracle | $500 億 | NVIDIA GPU | OpenAI の主要インフラパートナー |

| OpenAI | 計算費 $500 億 | NVIDIA GPU + カスタム | 収益の 2 倍規模の計算支出 |

| Anthropic | 総計 $2,500 億+ (5年計画) | GPU + TPU + ASIC 分散 | 4 ルート分散、月内 300MW 即時調達 |

使い分けの推奨:AI 開発者が読み取るべき含意

Claude を使う開発者・企業にとってこの動きが意味するのは「計算容量の急拡大 → Claude の使用上限引き上げ → よりスケールしたエージェント的ワークロードへの対応」だ。Anthropic は 2026 年 5 月に xAI Colossus 1 の稼働を受けて Claude の使用制限を大幅引き上げると発表した。

クラウド選定担当者には、Anthropic の多ベクトル戦略が「AWS・Google Cloud・Azure のどの基盤も使える」ことを意味するため、ベンダーロックインを避けたい企業にとって Claude は有利な選択肢となる。

電力制約問題は全事業者共通の悩みだ。Microsoft の $800 億バックログは氷山の一角で、2026 年後半の AI 計算供給は電力インフラ整備速度に律速される。データセンター冷却・再エネ調達・送電網整備のリードタイムが AI 能力開発ペースを決める時代が来た。

2026 年の見通し

カスタムシリコンの加速: 2027 年に本格稼働する Anthropic 向け Broadcom カスタム ASIC は、NVIDIA GPU 独占への挑戦を示す。Google TPU、AWS Trainium、そして各社カスタム設計が GPU 市場を補完するエコシステムへ移行しつつある。

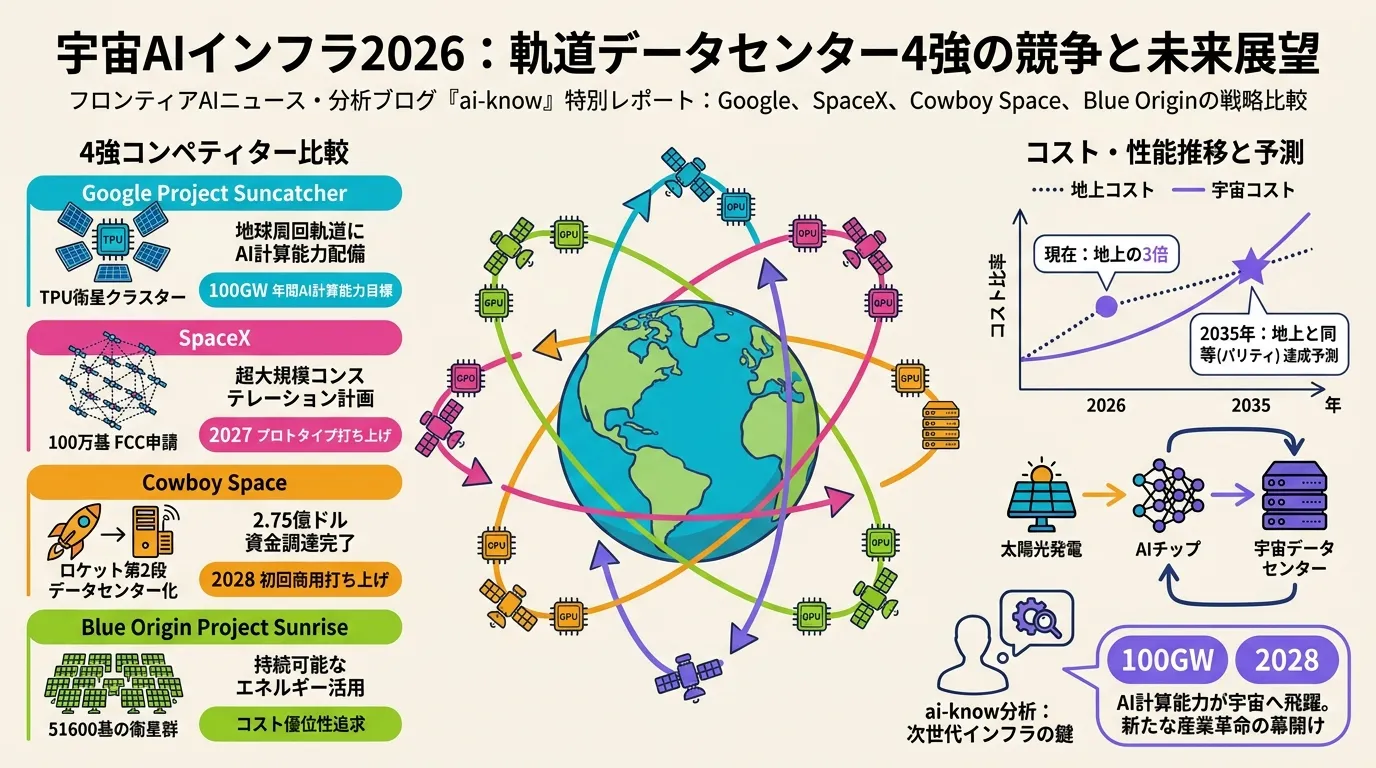

軌道上データセンター: Anthropic は xAI との契約で「複数ギガワット規模の宇宙計算キャパシティ」への関心を表明した。SpaceX のロケット・衛星インフラと AI 計算の融合は SF から戦略計画へ移りつつある。

ハイパースケーラー外の資本: Moonshot AI の $20 億調達(評価額 $200 億)や Sierra の $9.5 億調達が示す通り、AI スタートアップが独自計算インフラを持つのではなくクラウド経由で大手の計算をレンタルするモデルへの収斂も進む。AI インフラ の支配構造は少数の超大規模プレイヤーに集約される一方、AI 商用化 の波及は垂直特化の中小企業にまで拡大する二極化が鮮明だ。

参考:Anthropic、米国 AI インフラに $500 億投資(Anthropic, 2025)、Google・Broadcom とのコンピュートパートナーシップ拡大(Anthropic, 2026)、SpaceX との計算キャパシティ契約(Anthropic, 2026)、xAI の Anthropic コンピュートパートナーシップ発表(xAI, 2026)、Anthropic の Google-Broadcom 契約 詳細(TechCrunch, 2026)、Anthropic、SpaceX Colossus 全容量を賃借(CNBC, 2026)、ハイパースケーラー 2026 年 CapEx $690B(Futurum, 2026)、Big Tech、AI インフラに $700B(Fortune, 2026)、Broadcom、Anthropic/Google に $200B 規模の TPU 供給(Bloomberg / BigGo, 2026)

関連記事

宇宙 AI インフラ 2026 — Google・SpaceX・Cowboy Space・Blue Origin の軌道上計算レース比較

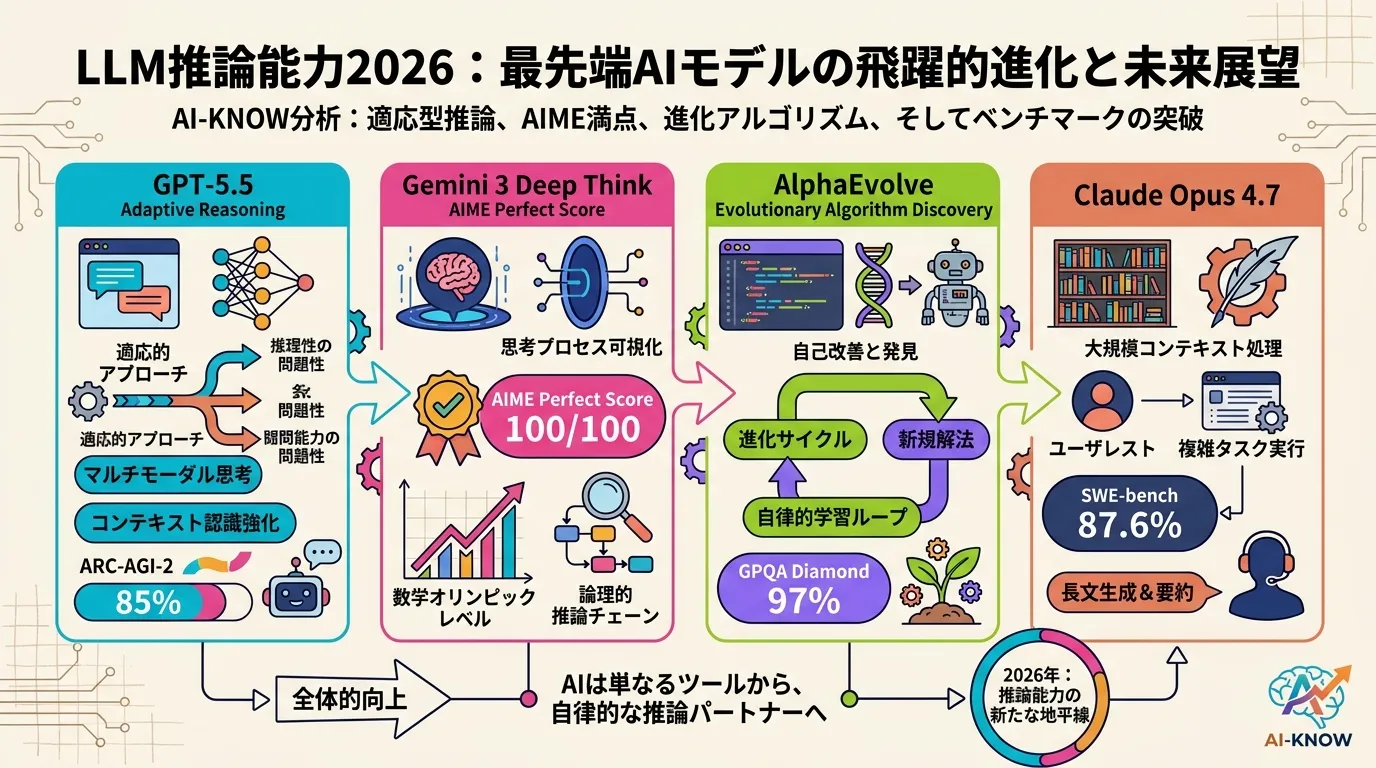

LLM 推論能力の現在地 2026 — GPT-5.5 / Gemini 3 Deep Think / AlphaEvolve を比べる

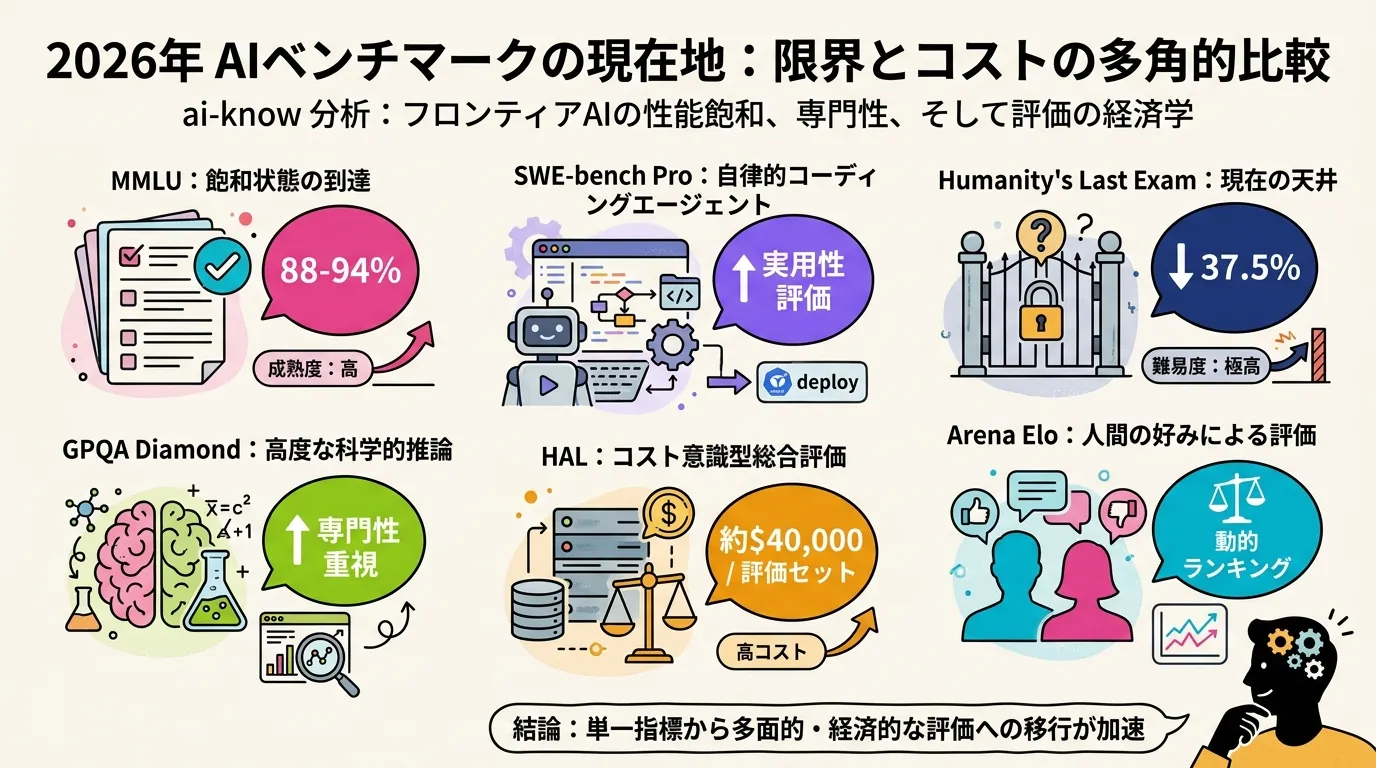

AI 評価インフラの現在地 2026 — MMLU 飽和から HAL・SWE-bench Pro・HLE まで、ベンチマーク選択の実践ガイド

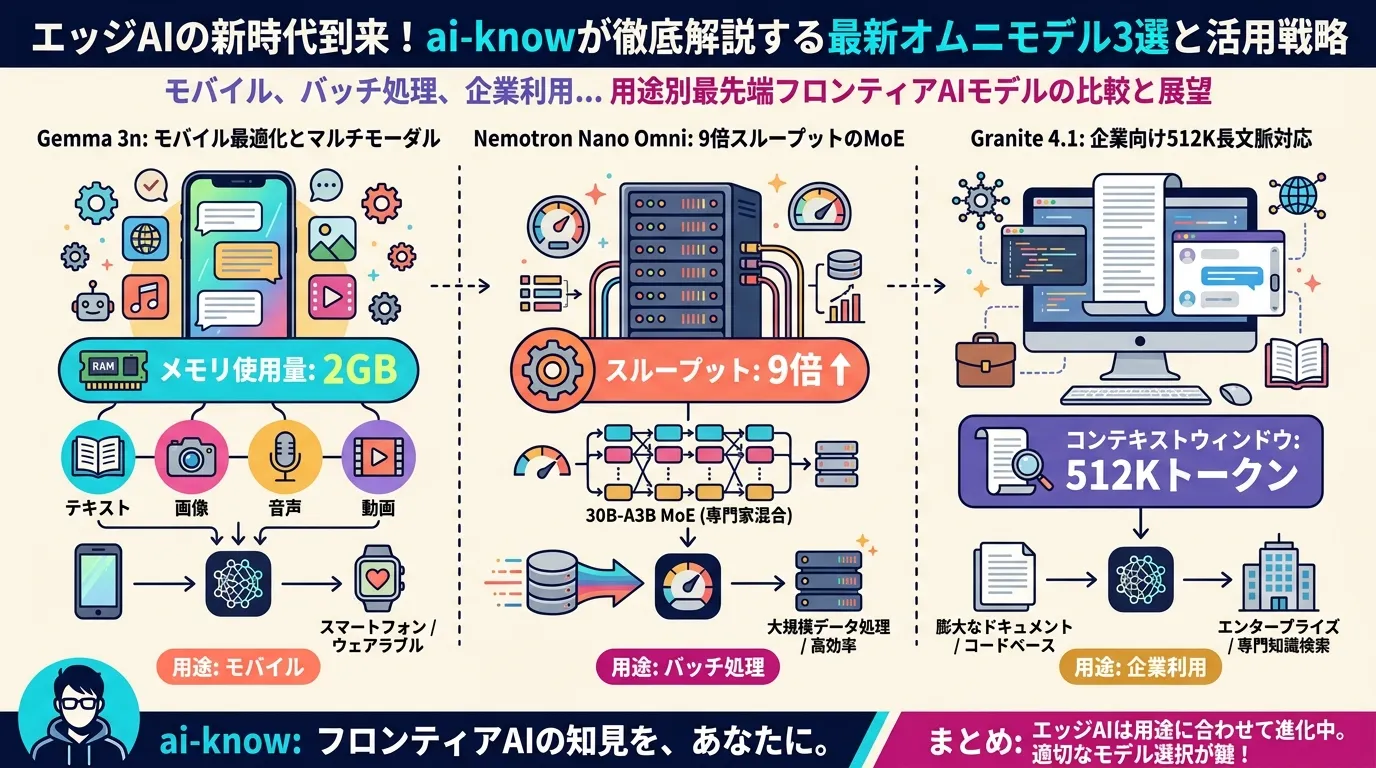

エッジ向けオムニモデルの現在地 2026 — Gemma 3n / Nemotron Nano Omni / Granite 4.1 を用途別に比較する

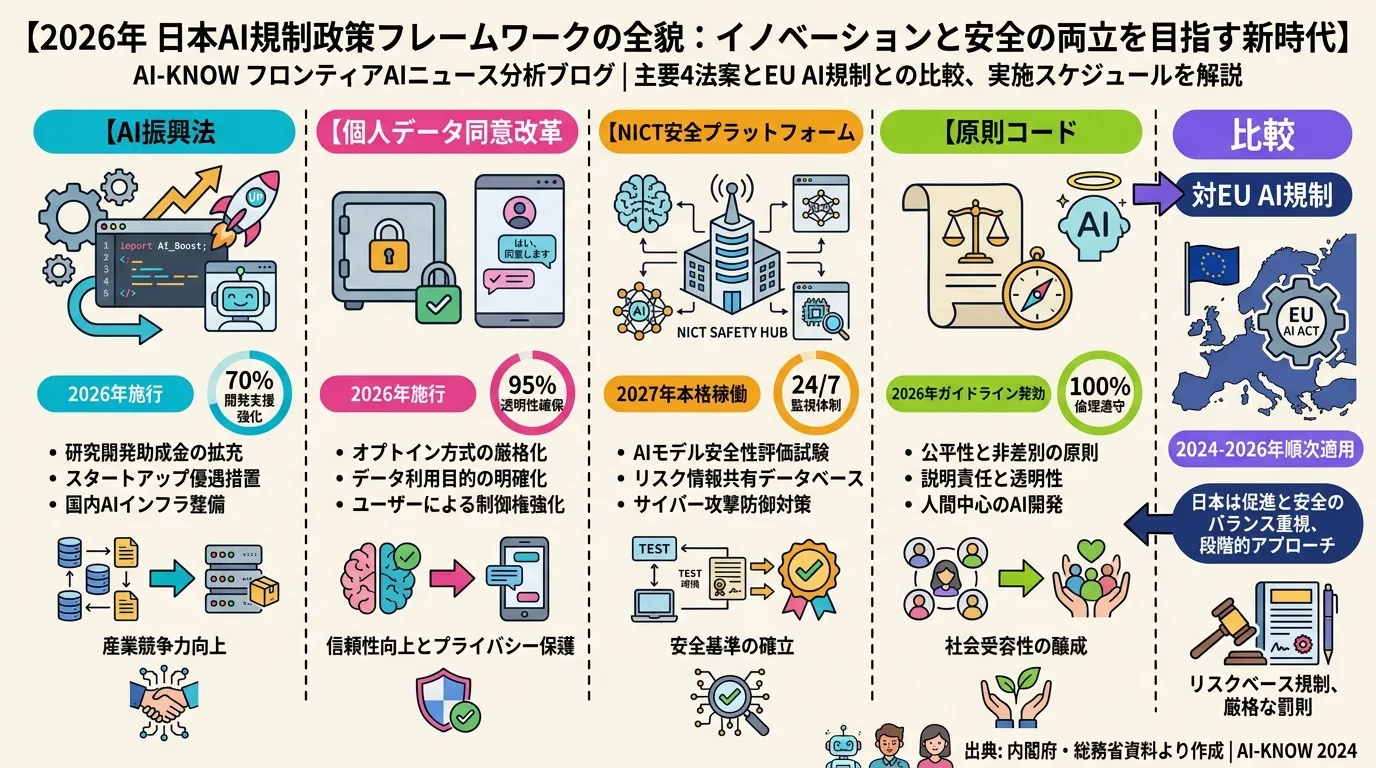

日本 AI 規制2026最新動向 — 推進法・データ同意免除・NICT 評価基盤が三つ巴で動く